[转贴] 从几个月到几分钟,NLP模型运行效率暴涨,小公司也能玩大模型

Tan KW

Publish date: Sat, 25 Jun 2022, 12:21 AM

智东西(公众号:zhidxcom)

编译 | 夏舍予

编辑 | 云鹏

智东西6月24日消息,据外媒VentureBeat报道,美国AI芯片创企Cerebras Systems创造了在单个设备上运行最大参数量NLP模型(自然语言处理模型)的记录。

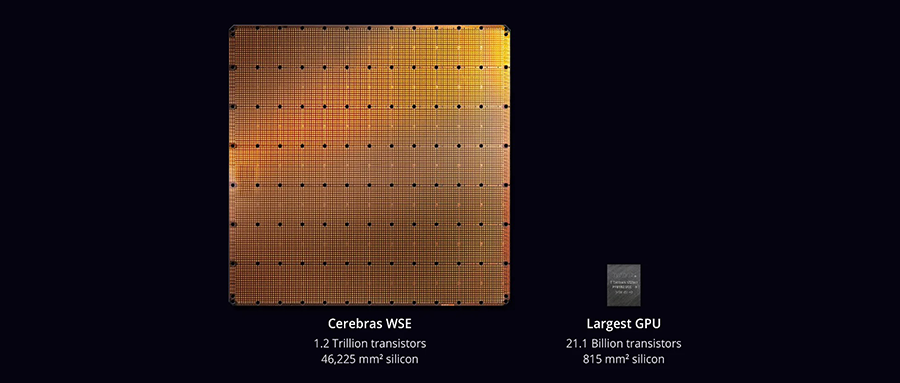

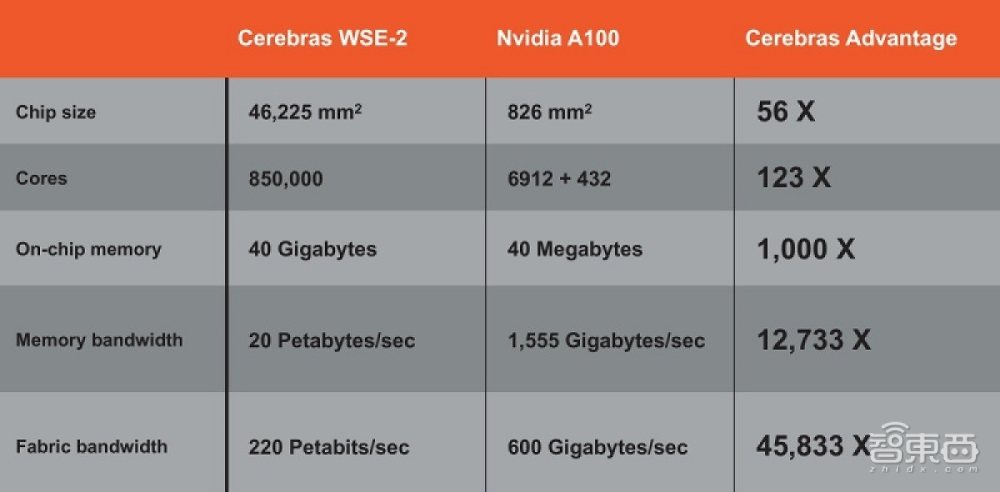

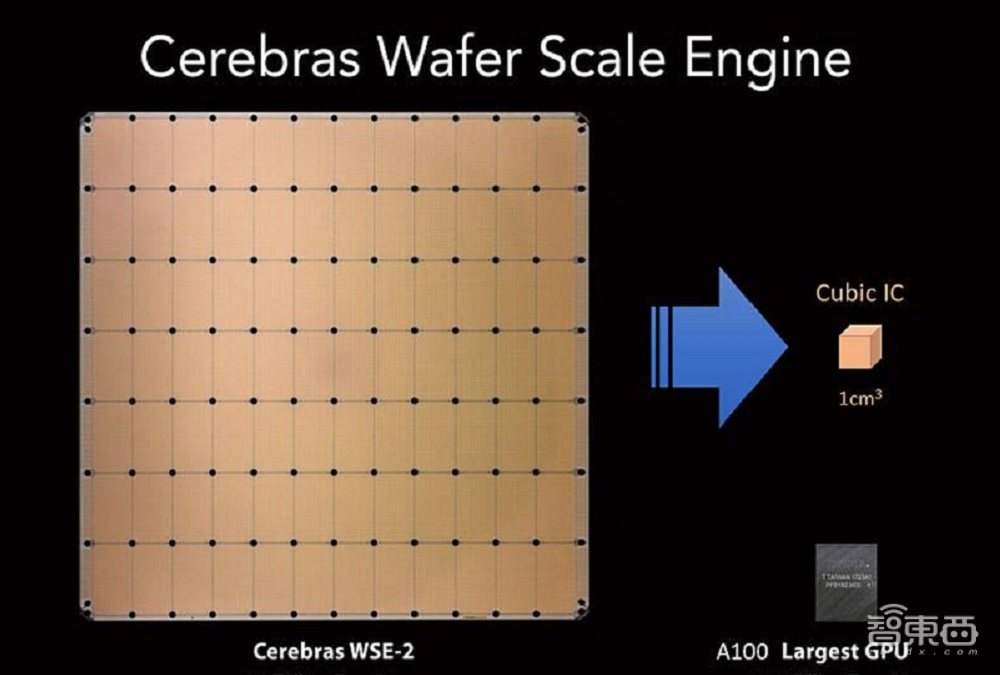

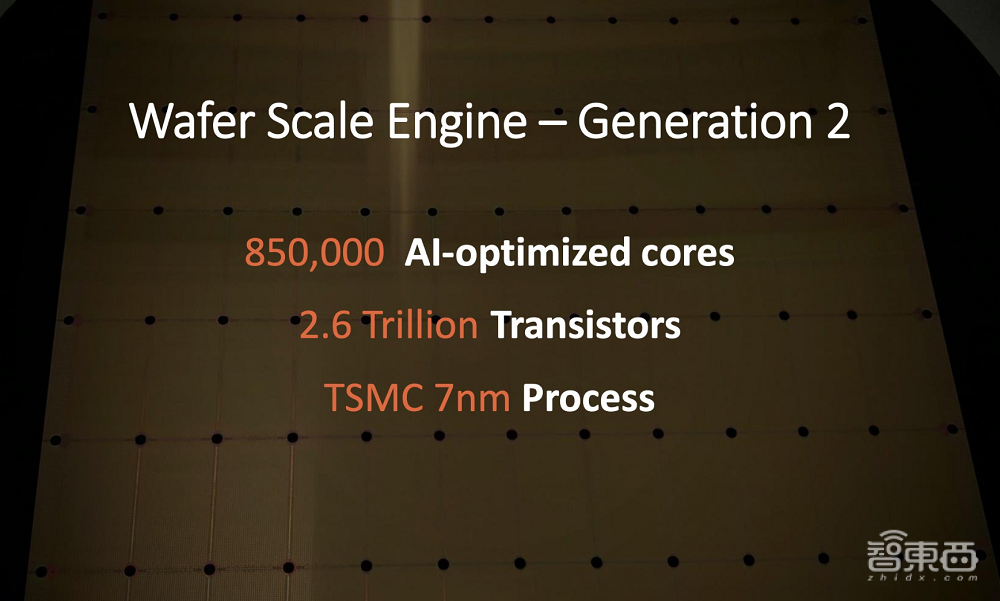

这要归功于Cerebras Systems公司的CS-2系统和WSE-2芯片。WSE-2芯片是该公司在2021年4月发布的巨型晶圆芯片,WSE-2芯片比世界上现存的最大芯片Ampere A100多2.55万亿个晶体管。WSE-2芯片的内核是Ampere A100的123倍,内存是Ampere A100的1000倍,可提供的内存宽带是A100的12000倍。

WSE-2芯片为Cerebras Systems公司打造的CS-2系统提供核心算力。

▲Cerebras的WSE-2与英伟达的A100 GPU的性能参数对比(图源:Cerebras)

一、从几个月到几分钟,NPL模型运行时间骤缩

Cerebras Systems公司表示,CS-2系统只需要一个WSE-2晶圆芯片就可以在单个设备上运行参数量数十亿的NLP模型(自然语言处理模型),这些模型包括GPT-J 6B、GPT-3 13B和GPT-NeoX 20B。

Cerebras Systems公司的首席执行官安德鲁·费尔德曼(Andrew Feldman)表示,Cerebras Systems公司发明了一个新的软件执行架构技术,该技术被称为Weight Streaming。这种新的技术分解了计算和参数存储,首次实现在芯片外存储模型参数。并且Weight Streaming技术消除了延迟和内存带宽问题,极大地简化了工作负载分配模型。因此,一个单独的CS-2系统就能为具有数万亿参数的模型提供算力。

“每个GPU的内存是固定的”,费尔德曼说,“如果模型的参数量大于其GPU内存的支持上限,就要增加GPU的数量,再把工作分散到多个GPU上,这会导致模型运行的复杂性爆炸式增长。”Cerebras Systems公司的Weight Streaming技术可以分解计算和参数存储,实现在单个CS-2系统上运行任意数量参数的模型。

费尔德曼表示,通过WSE-2芯片的计算能力和Weight Streaming的技术支持,Cerebras Systems公司可以实现在单个CS-2系统上支持最大参数规模的NLP模型。这不仅缩短了模型的运行时间,也简化了模型的操作方式。人们只需要敲几下键盘,就可以在GPT-J和GPT-Neo(两种NLP模型)之间进行切换。这项任务在数百个GPU的集群上需要数月的工程时间才能完成,而Cerebras Systems公司把这个时间缩短到了几分钟。

费尔德曼说:“机器学习社区需要花费几个月才能做到的事情,在我们这里只需要按16下。”

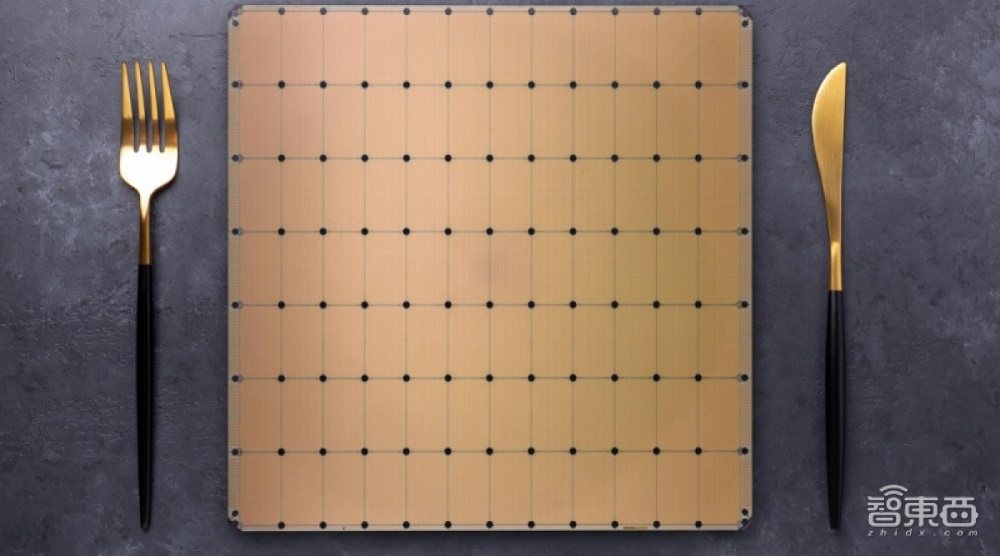

▲Cerebras公司的CS-2系统采用的晶圆大小的芯片(图源:Cerebras)

二、降低门槛,让任何组织都能运行大型NLP模型

费尔德曼表示,研究证明,参数量越大的NLP模型运行的效果越准确。但是有足够的资源和专业知识能分解这些大型模型,并在数百或数千个GPU上进行分布式训练的公司非常少。

费尔德曼说:“随着技术的进步,NLP模型的参数量一直呈指数增长,这使得其体量变得越来越庞大。因此,只有很少的公司有能力使用它们。我们改变了这一现状,任何组织都能以轻松的方式使用大型NLP模型。”这不是费尔德曼单方面的说法,还获得了Intersect 360 research的首席研究官丹·奥兹(Dan Olds)的认可。

丹·奥兹一份声明中说:“Cerebras Systems公司降低了大型NLP模型的运行门槛,开启了一个新的人工智能时代。Cerebras Systems公司为那些无法花费数千万美元购买设备的组织提供了一个轻松、廉价的途径,让这些公司有机会进入NLP大联盟。”

▲Cerebras 公司的WSE-2芯片与最大GPU的对比(图源:Cerebras)

三、客户遍布全球,新系统可助基因研究

目前,这项技术已经在全球范围内被广泛采用。Cerebras Systems公司在北美、亚洲、欧洲和中东地区都有客户,这些客户包括GSK、阿斯利康、TotalEnergies、匹兹堡超级计算中心、莱布尼茨超级计算中心、爱丁堡并行计算中心(EPCC)、国家能源技术实验室等等。

这项技术在客户公司中广获好评。英国制药公司GSK是CS-2系统的使用客户之一,该公司的人工智能高级副总裁Kim Branson表示:“GSK需要新的设备来处理通过基因组和基因研究生成的极其庞大的数据集。而Cerebras Systems公司的CS-2系统在我们公司使用生物数据集进行语言模型训练中承担重要功能。使用这个系统后,我们能够处理的数据规模远远超过以前。这个模型是GSK公司许多人工智能系统的基础,在我们进行药物转型研究方面发挥着重要作用。”

▲WSE-2芯片的主要参数配置(图源:Cerebras)

结语:CS-2系统实现技术突破,推动人工智能向前发展

Cerebras Systems公司的CS-2系统可以在单个设备上运行参数量超过数十亿的NLP模型,这是人工智能领域的一项重要技术突破。这不仅扩充了单个设备上NLP模型的参数容量,还让更多公司能够使用大型NLP模型,扩大其应用市场。

但是,AI技术想要获得突破,不能只靠提高参数数量,扩大模型体量。就像CPU的主频一样,AI模型的参数量只是一个指标。更重要的是用更少的参数达到更好的结果。毕竟,训练AI模型的目的是让这些模型工作得更聪明,而不是更努力。

来源:VentureBeat

https://zhidx.com/p/335083.html

More articles on Future Tech

Created by Tan KW | Aug 07, 2024

Created by Tan KW | Aug 07, 2024

Created by Tan KW | Aug 07, 2024

Created by Tan KW | Aug 07, 2024

Created by Tan KW | Aug 07, 2024